Forskere fra MIT, Worcester Polytechnic Institute og Google har foreslået en ny debiasing-metode til vision-language-modeller. Metoden hedder Weighted Rotational DebiasING, forkortet WRING, og arbejdet er ifølge MIT News accepteret til ICLR 2026. Det gør ikke i sig selv metoden færdigvalideret, men det gør historien relevant, fordi den går direkte ind i et velkendt problem i feltet.

MIT beskriver problemet sådan: Mange vil gerne reducere bias i AI-modeller, men de mest brugte greb kan ændre andre relationer i modellen undervejs. Så man retter ét sted og risikerer at forrykke noget andet. Det er det dilemma, forskerne forsøger at adressere med WRING.

Bias kommer ikke kun fra data

En central pointe i MITs gennemgang er, at bias i AI ikke kun handler om skæve træningsdata. Kilden skriver også, at modelarkitekturen kan indeholde og forstærke bias. Ifølge MIT kan det påvirke modellens ydeevne negativt i virkelige anvendelser.

Det er en vigtig præcisering, fordi bias ofte bliver omtalt, som om problemet begynder og slutter med datasættet. MITs fremstilling peger på, at skævheder også kan ligge i selve modellen og i den måde, den organiserer relationer på. Det gør debatten mere teknisk, men også mere præcis.

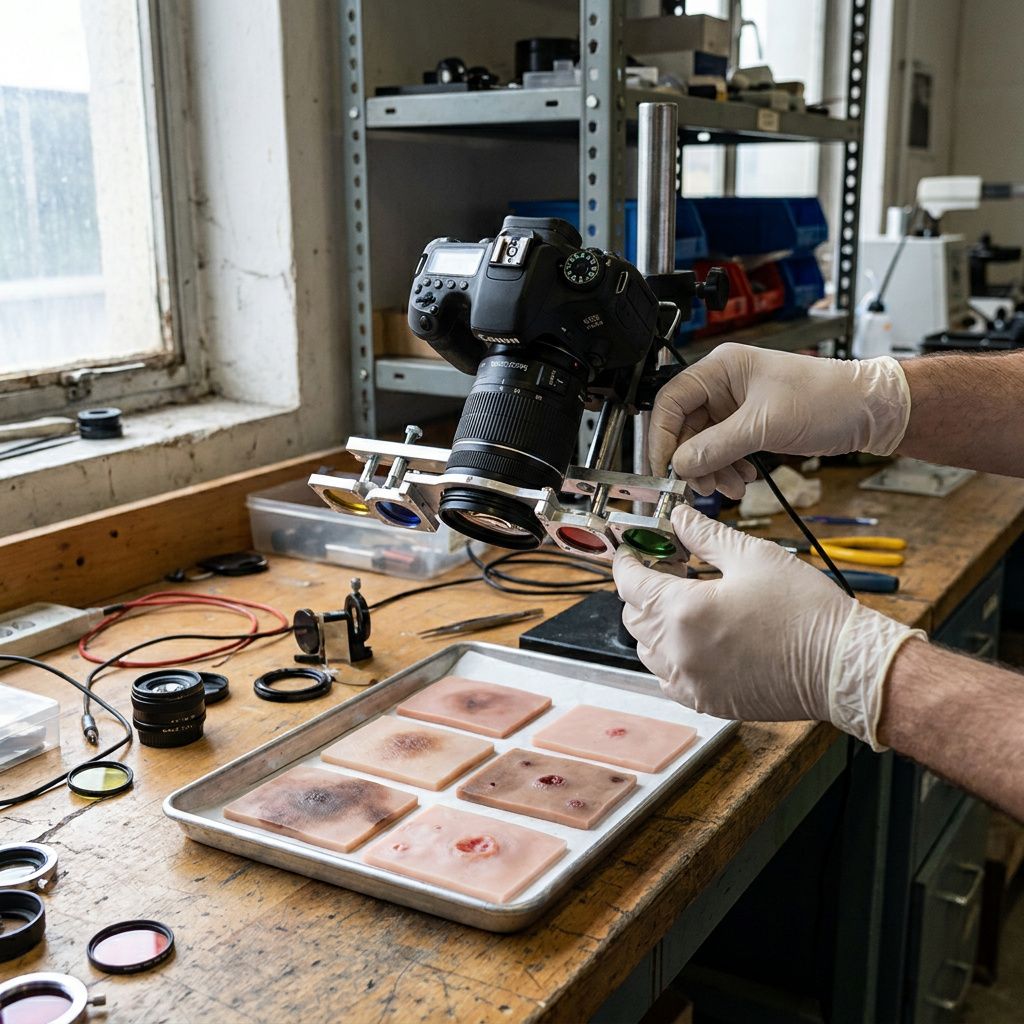

I højrisikoområder bliver den pointe ekstra tydelig. MIT bruger et eksempel fra dermatologi, hvor en AI-model bruges til at klassificere hudlæsioner. Hvis modellen er biased mod bestemte hudtoner, kan den ifølge kilden overse en patient med høj risiko.

Hvad vision-language-modeller er

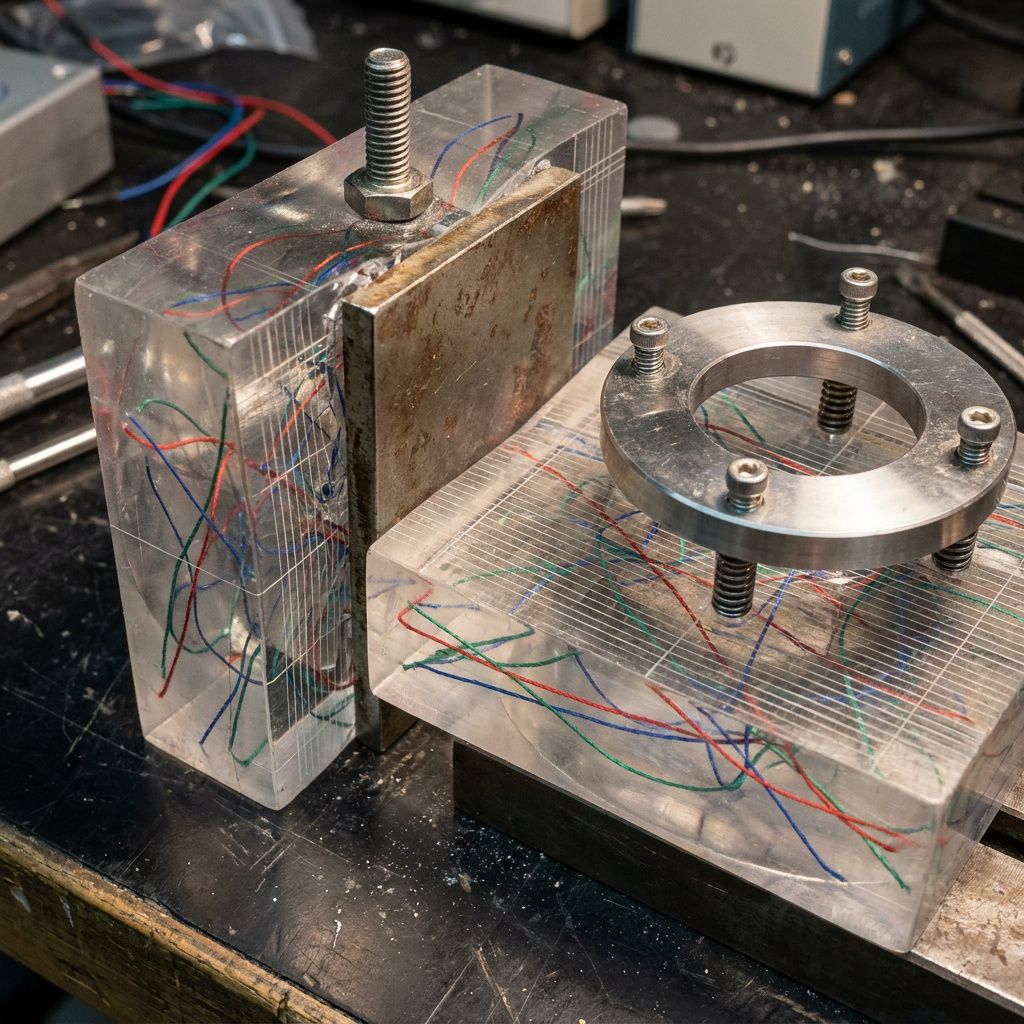

WRING er udviklet til vision-language-modeller, ofte forkortet VLMer. MIT beskriver dem som multimodale modeller, der kan forstå og fortolke flere datatyper samtidigt, som tekst, billeder og video. Det er altså modeller, der arbejder på tværs af flere former for input i samme system.

Den definition er vigtig, fordi bias i sådanne modeller ikke kun handler om ét enkelt datalag. Når en model kobler sprog og billeder sammen, kan skævheder i relationerne mellem de to dele få betydning for resultatet. Det er netop den slags relationer, debiasing-metoder forsøger at påvirke.

MIT placerer derfor WRING i et område, hvor udfordringen ikke bare er at forbedre et datasæt, men at ændre noget i en allerede trænet model uden at forstyrre resten for meget. Det er også derfor, kilden bruger så meget plads på den eksisterende metode, som WRING lægger sig op ad og forsøger at forbedre.

Den mest brugte metode har en kendt bagside

Ifølge MIT er den mest almindeligt anvendte tilgang til debiasing af vision-language-modeller projection debiasing. Kilden beskriver den som en post-processing-metode, hvor man forsøger at fjerne uønsket bias ved at projicere et bias-subrum ud af modellens repræsentationsrum. Sagt mere enkelt er ideen at skære den uønskede skævhed væk fra modellens indre repræsentationer, efter modellen allerede er trænet.

MIT kobler den metode til det, forskningen har kaldt Whac-A-Mole-dilemmaet. Det dækker over, at man kan fjerne bias ét sted og samtidig ændre andre relationer, som modellen har lært. Førsteforfatter Walter Gerych siger i MITs artikel, at når man gør det, kommer man også til at “squish” det omkringliggende, så andre relationer flytter sig.

Det er kernen i problemet, som WRING er sat i verden for at adressere. Ikke bare bias som sådan, men bivirkningen ved at fjerne den med et greb, der også kan forstyrre resten af modellen. Det er en mere snæver og mere teknisk påstand end et løfte om at løse bias bredt.

Hvorfor det betyder noget

MITs dermatologi-eksempel gør pointen konkret. En model kan bruges til at vurdere, om en hudlæsion ser godartet ud eller giver mistanke om kræft. Hvis modellen fungerer dårligere for bestemte hudtoner, kan den ifølge kilden overse en patient med høj risiko.

I MITs fremstilling bliver bias dermed ikke bare et spørgsmål om abstrakt fairness. I sådanne tilfælde hænger bias direkte sammen med modellens kvalitet og sikkerhed. Kilden beskriver ligefrem bias som et centralt sikkerhedsproblem i medicinske højrisikosituationer.

Det gør også Whac-A-Mole-dilemmaet mere alvorligt. Hvis en debiasing-metode ændrer andre relationer i modellen undervejs, er spørgsmålet ikke kun, om man har reduceret én skævhed. Spørgsmålet er også, hvad man ellers har flyttet på.

Hvad der kan siges om WRING

Det udleverede materiale dokumenterer sikkert, at WRING er navnet på den nye metode, at den er udviklet af forskere fra MIT, Worcester Polytechnic Institute og Google, og at arbejdet er accepteret til ICLR 2026. Materialet dokumenterer også, at metoden bliver præsenteret som et svar på den kendte bagside ved projection debiasing.

Derimod er der i det verificerede materiale her ikke nok detaljer til at slå mere præcist fast, hvordan WRING teknisk virker trin for trin, eller hvor bredt resultaterne kan generaliseres. Derfor er det mest præcise at holde sig til MITs overordnede ramme: Forskerne foreslår en ny tilgang, som skal adressere Whac-A-Mole-dilemmaet i vision-language-modeller.

Det er også værd at holde fast i, at der her er tale om forskning omtalt gennem MIT News. Det giver et solidt grundlag for hovedfakta om forskerhold, problemstilling og metodekategori. Men det er ikke det samme som en bred, uafhængig validering på tværs af mange miljøer og anvendelser.

Det ændrer ikke hele fairness-debatten, men det flytter noget

Det mest interessante ved historien er måske, at den skærper et gammelt spørgsmål i AI-forskning. Hvis en model er biased, er det ikke nok kun at spørge, hvordan bias fjernes. Man må også spørge, hvad der sker med de andre relationer i modellen, når man gør forsøget. Det er præcis det problem, MIT beskriver omkring projection debiasing.

WRING skal læses ind i den sammenhæng. Ikke som et dokumenteret endeligt svar på bias i multimodale modeller, men som et forskningsforslag, der retter sig mod en konkret og allerede kendt svaghed ved den mest brugte debiasing-tilgang. Det er en mere nøgtern, men også mere holdbar måde at læse nyheden på.

Og der ligger en reel substans i det alene. For hvis MITs beskrivelse holder, peger arbejdet på, at debiasing ikke kun bør vurderes på, om en skævhed bliver mindre, men også på om andre dele af modellen ændrer sig undervejs. Det er ikke en lille teknisk fodnote. Det er selve sagen.